教育部學術倫理電子報

生成式人工智慧(AI)快速的普及,為教育與研究場域帶來了明顯的影響,使高等教育與學術社群必須重新檢視知識產生與驗證的方式,本期主題文章提出「合情、合理、合法」的善用AI使用框架,此架構旨在協助學習者與研究者理解自身使用AI的需求,並在現行規範下維持必要的透明度與誠信原則。第二部分「中心新訊」回顧近期 AREE 更新內容,包括:上架 5 集 Podcast 廣播節目、新增 2 部情境影片、新增 2 主題之議題教材包、擴充領域辭典、上架 1 本教育電子書、擴充測驗題庫,新訊請點此查看。

二、生成式AI對學術誠信的三項挑戰

生成式AI的運作涉及資料收集與整理、模型訓練、推論生成等層面,因此其使用自然牽動多重倫理討論。首先,在資料倫理上,需關注詞彙表建立、資料來源多元性以及偏差再製的風險。其次,演算法倫理涵蓋模型架構設計、微調策略、內容審查機制,以及開發者如何處理不當內容。再者,資訊倫理涉及使用者的AI素養,包括辨識虛假資訊、理解個資風險與評估AI的可信度。同時,研究倫理關注AI在研究流程中的角色,例如是否影響研究透明度與研究受試者的權益。最後,學術倫理則聚焦AI與知識產出之間的界線問題,包括引用方式、原創性與可驗證性。本文即以學術倫理視角作為後續介紹的重點。

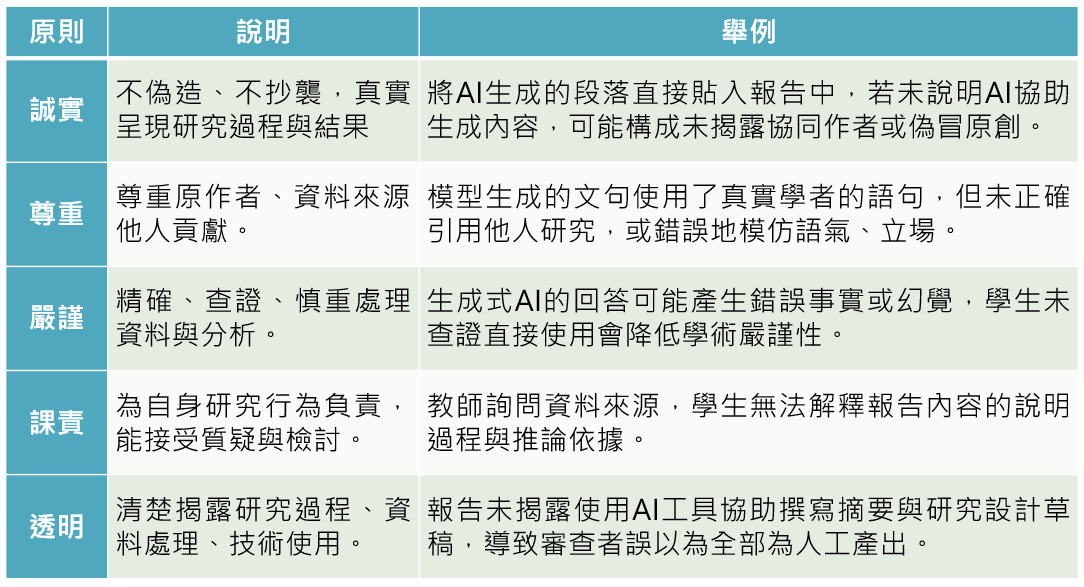

由台灣聯合大學系統編纂之《臺灣研究誠信守則》,為研究人員與參與計畫的相關人員提供了從事研究應依循的行為守則。隨著生成式AI的興起與快速普及,學術研究與知識詮釋的產出方式正經歷深刻變革,《臺灣研究誠信守則》裡所定義的「誠實、尊重、嚴謹、課責、透明」五項原則,正是研究者工作信條的基礎。然而知識產生的方式、資料處理的過程與論述建構的方法皆因現今生成式AI的普及帶來了大幅改變,亦使這五項原則的實踐面臨新的挑戰。例如,AI生成內容的「真實來源」不易追溯,使誠實與透明面臨風險;模型輸出可能混合不同語境的資訊,使嚴謹性受到考驗;若研究者未揭露AI介入程度,則課責與尊重(例如對原著作者、受試者、資料提供者)亦可能受到影響(如表1)。

表1 生成式AI對學術誠信原則的影響

資料來源:作者自行整理。

這些考驗為教育與研究的學術誠信帶來的挑戰包括:

在生成式AI已成為寫作工具的情況下,原創性的判斷出現新的模糊帶。許多使用者的確自行完成初稿,但在最後階段交由AI進行潤飾或重寫,使文本呈現明顯的AI語氣或句型。這類「人機共作」原意並非有意抄襲,但若未清楚揭露AI介入程度,外觀上容易被誤認為完全由AI生成,也使作品中「哪些部分屬於作者、哪些部分由工具加工」的界線不再明確。這正是AI時代學術誠信所面臨的首要挑戰之一。

生成式AI可能產生看似合理但實際不存在的文獻,也就是幻覺引用(Ji et al., 2023),或錯誤整合不同研究的內容。若使用者缺乏查核能力,可能直接採用錯誤資訊,導致引用失真、資料解讀偏差,甚至在專業研究中影響研究結果的可靠度。這種依AI、卻不依來源的習慣,將使學習者忽略文獻查證、比較與批判閱讀等核心學術能力。

傳統以寫作成果判定能力的方法,難以區分哪些內容由AI協助產生。現行AI偵測工具雖然廣泛使用,但研究已指出其誤判率偏高(OpenAI, 2024),甚至可能對非母語者產生歧視性誤判。這使教師在評量時面臨困難:過度依賴偵測工具會傷害學生的正當權益,而缺乏明確規範又可能讓評量標準失去一致性。

生成式AI改變了教育與研究的歷程,亦考驗著學術誠信的內涵與實踐方式。面對這些挑戰,建立明確揭露、查證與負責任使用的原則與規範,已是教育圈、學術社群甚至是整體社會接下來不可迴避的關鍵任務。

三、對於生成式AI的多層次回應與法規建構

(一)個人層次:識別與改善AI生成文本的特徵

使用生成式AI的過程中,不管是學生、教師或研究相關人員,都應具備基本辨識AI文本的能力,並主動修正這些特徵,以確保生成的結果符合嚴謹、誠實及具備個人洞見的基本要求。以下介紹六項生成式AI產出文本的常見特徵,以及相對應的改善方向。

由於模型依賴機率選取常見語言模式,容易生成重複句型或模板式結尾,例如在開頭、轉折、結尾套用「整體而言,這是一項值得進一步探索的主題」等類似句式。使用者可改寫句式、調整語氣,避免過度制式的段落結構,使內容更符合人類自然寫作風格。

AI模型傾向呈現中性敘述,以避免偏頗,因此生成內容常缺乏明確觀點,例如「有些人支持此政策,認為它能促進發展;也有人反對,擔心會產生副作用」。使用者可嘗試提出更明確的主張與理由,並對於對立觀點有所回應與評析,使文本具體且具備作者思考軌跡。

AI模型為降低錯誤風險,常會使用「可能、大多數、相對來說」等模糊詞語,例如「這項技術可能在未來某些領域產生一定程度的影響」。使用者可加入具體條件、例證或參考來源,像是「在A條件下,將會產生B影響」,使論述更具實證基礎與增加文本的說服力。

AI模型非人類不具實際生命體驗,其生成回答內容多為第三人稱且廣泛、概括,缺少第一人稱的故事與細節。故使用者可以加入個人觀點、經驗或具體案例,使內容更具可信性與真實感。

AI模型透過大量語言資料學習常見模式,因此傾向生成安全、常見或平均化的結論,常符合大眾預期,不太會生成出人意料或具衝突性的結論。使用者可加入反思性問題、批判性觀點或具有挑戰性的問題視角,使論述具不同層次的思考,內容將更具價值。

AI是大型語言模型,並非資料庫查詢系統,其引用往往來自語言模式組合而非真實查詢結果,故可能產出虛構來源或模糊的出處名稱。使用者必須逐項查證文獻的存在,確認能否在搜尋引擎或其他可靠來源查到該文獻,確保引用的嚴謹性。

不管技術再怎麼創新,生成式AI仍受限於訓練資料時間與來源品質,因此可能產生錯誤資訊、過時內容或虛構引用,使用者在採用AI的產出時,必須謹慎看待AI生成的內容,保有查核意識與批判性閱讀能力。